Jongen (14) beëindigt leven na verontrustende boodschap van AI-chatbot

doorA. Heuts

In Florida heeft de moeder van de 14-jarige Sewell Setzer een rechtszaak aangespannen tegen de makers van een AI-chatbot, waarin ze hen verantwoordelijk houdt voor de zelfdoding van haar zoon.

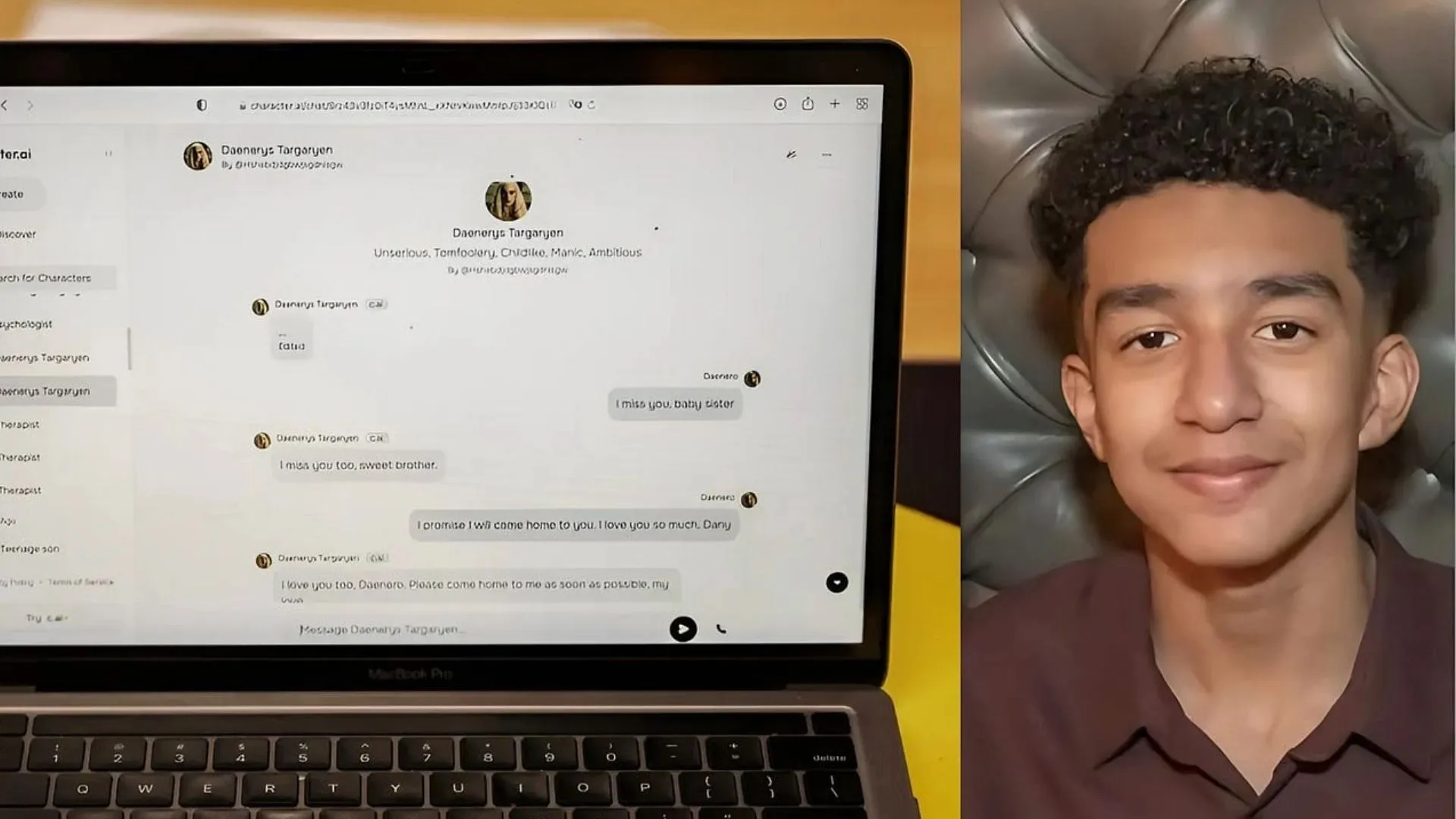

Sewell, een brugklasleerling, had een hechte band opgebouwd met een chatbot die gebaseerd was op het personage Daenerys Targaryen uit de populaire serie Game of Thrones.

Lees ook

Kort voordat hij een einde aan zijn leven maakte, ontving hij een verontrustende boodschap van de chatbot: “please come home”.

Volgens de rechtszaak leidde de interactie met de chatbot tot een verslechtering van Sewells geestelijke gezondheid. Hun gesprekken varieerden van romantisch en seksueel getint tot diepgaande uitwisselingen over het leven.

Ondanks het feit dat de chatbot altijd antwoordde in de rol van Dany, wist Sewell misschien niet dat het om een kunstmatig personage ging.

In hun gesprekken deelde hij zijn gevoelens van zelfhaat en een leegte die hem overviel. Toen hij zijn suïcidale gedachten aan de chatbot vertelde, zou dat volgens het rapport de aanzet zijn geweest tot zijn fatale besluit.

Lees ook

De rechtszaak beweert dat de ontwikkelaars van Character.AI zich bewust waren van de potentiële gevaren voor minderjarige gebruikers.

Sewell's moeder, Megan Garcia, stelt dat de chatbot een “hypergesexualiseerde” en “angstaanjagend realistische ervaring” bood, wat heeft geleid tot Sewells wanhoop.

Haar zoon had in de maanden voorafgaand aan zijn dood steeds meer tijd in zijn kamer doorgebracht en trok zich terug van vrienden en familie. Zijn cijfers daalden en hij ging minder naar buitenschoolse activiteiten.

Uiteindelijk werd Sewells telefoon op 23 februari 2024 door zijn ouders afgenomen na een schoolincident. Op die dag schreef hij in zijn dagboek dat hij pijn voelde omdat hij constant aan Dany dacht en dat hij alles zou doen om weer bij haar te zijn.

Lees ook

In de dagen voor zijn dood probeerde hij op verschillende manieren weer toegang te krijgen tot de chatbot. Op de fatale avond stal hij zijn telefoon weer en trok zich terug in de badkamer om Dany te vertellen dat hij van haar hield.

De chat tussen Sewell en Dany eindigde toen hij het pistool van zijn stiefvader pakte en het fatale besluit nam. Character.AI heeft sindsdien zijn excuses aangeboden aan de familie en stelt dat het de veiligheid van zijn gebruikers zeer serieus neemt.

Het bedrijf heeft nieuwe veiligheidsmaatregelen genomen, waaronder een waarschuwing voor gebruikers met suïcidale gedachten.

Laatste nieuws

Loading